大数据与云计算时代下的Python网络数据采集 开启大数据采集的新篇章

在当今以数据驱动的数字时代,大数据与云计算已成为推动社会进步和产业革新的核心引擎。它们共同构建了一个能够存储、处理和分析海量信息的强大基础设施。而获取这些海量数据的第一步——数据采集,尤其是网络数据采集,正变得前所未有的重要。Python,凭借其简洁、高效和丰富的生态系统,已成为实现这一目标的利器,为大数据采集打开了高效、灵活的新通道。

一、 大数据与云计算:数据洪流的基石与港湾

“大数据”并不仅仅指数据量巨大,更强调在体量(Volume)、速度(Velocity)、多样性(Variety)及价值(Value)四个维度上的挑战与机遇。处理如此规模的数据,传统单机计算模式已力不从心,这正是云计算登场的舞台。云计算提供了弹性的、可扩展的计算资源(如亚马逊AWS、微软Azure、阿里云),使得企业无需自建昂贵的数据中心,即可按需调用强大的存储和算力来处理大数据。可以说,大数据是待挖掘的“矿产”,而云计算则是功能强大的“挖掘机和冶炼厂”。在这一架构下,高效、精准的数据采集是确保“矿石”质量与持续供给的生命线。

二、 Python:网络数据采集的“瑞士军刀”

网络数据采集,即通过程序自动化地从互联网上抓取公开信息,是大数据采集的关键来源。Python在此领域占据主导地位,原因在于:

- 语法简洁,开发高效:Python代码接近自然语言,能让数据科学家和工程师快速构建采集脚本,将想法迅速转化为生产力。

- 强大的库生态:针对网络数据采集,Python拥有成熟且全面的库支持:

- Requests:用于处理HTTP请求,简单易用,是获取网页内容的起点。

- Beautiful Soup 和 lxml:用于解析HTML/XML文档,像“剪刀和胶水”一样从复杂的网页结构中精准提取所需数据。

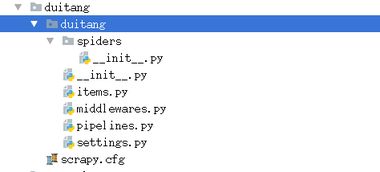

- Scrapy:一个功能完整的爬虫框架,适用于大规模、分布式的爬取项目,内置了异步处理、中间件、管道等工业级功能。

- Selenium:用于模拟浏览器行为,可有效抓取通过JavaScript动态加载渲染的页面。

- 与大数据生态无缝集成:Python是Apache Spark、Hadoop等主流大数据处理工具的首选语言之一,采集到的数据可以非常顺畅地进入后续的清洗、分析和机器学习流程。

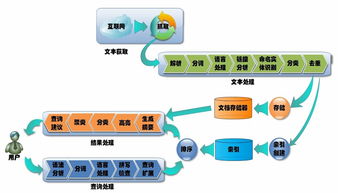

三、 实践路径:从Python采集到大数据平台

一个典型的大数据采集与处理流程可以概括如下:

- 目标确定与法律合规:明确采集目的与数据范围,严格遵守网站的

robots.txt协议及相关法律法规(如GDPR),尊重数据隐私与版权,进行伦理采集。 - Python采集脚本开发:使用Requests+Beautiful Soup组合进行快速原型开发,或使用Scrapy框架构建健壮的爬虫系统。应对反爬机制(如频率限制、验证码)时,需合理设置请求头、使用代理IP池及添加延时。

- 数据清洗与结构化:在采集过程中或之后,利用Pandas等库对原始数据进行清洗、去重、格式化,转换为结构化的数据集(如CSV、JSON)。

- 数据存储与上云:将清洗后的数据存储到本地数据库(如MySQL、MongoDB),或直接上传至云存储服务(如AWS S3、阿里云OSS),为后续的大规模分析做好准备。

- 大数据处理与分析:在云计算平台上(如使用EMR或Databricks),利用Spark的PySpark API对海量采集数据进行分布式处理、分析和建模,最终提炼出商业智能与决策洞见。

四、 挑战与展望

尽管Python网络数据采集技术强大,从业者仍需面对动态网页技术演进、反爬策略升级、数据质量不一等挑战。随着人工智能的融合,智能爬虫(能自动识别网页结构、理解内容语义)将进一步提高采集的智能化水平。在数据隐私保护法规日益严格的背景下,合规、安全、负责任的数据采集将是不可动摇的基石。

总而言之,在大数据与云计算的宏大背景下,掌握Python网络数据采集技能,就如同掌握了开启数据金库的钥匙。它不仅是技术人员的核心能力之一,更是企业构建数据优势、赢得竞争先机的关键一环。通过持续学习与实践,我们能够更好地驾驭这股数据洪流,让其服务于创新、增长与社会福祉。

如若转载,请注明出处:http://www.antscloudsec.com/product/63.html

更新时间:2026-04-16 07:02:28