大数据关键技术浅谈 从采集到处理的核心脉络

在信息技术迅猛发展的今天,大数据已成为驱动社会创新、产业升级和科学研究的重要引擎。理解和掌握大数据的关键技术,尤其是从数据采集到数据处理的完整流程,是把握这一时代脉搏的基础。本文将围绕大数据采集与处理两大核心环节,浅谈其关键技术要点与发展趋势。

一、 大数据采集:数据之源,万象之始

大数据采集是构建数据体系的起点,其核心任务是从各种异构数据源中,实时或批量地获取原始数据。采集的广度、深度、速度与质量,直接决定了后续所有分析与应用的上限。

关键技术包括:

- 多源异构数据采集技术:

- 日志与文件采集: 针对服务器、应用程序、传感器等产生的日志文件、文档、图像、视频等,常用工具如Flume、Logstash等,能够实现高吞吐量的日志聚合与传输。

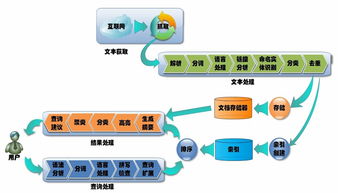

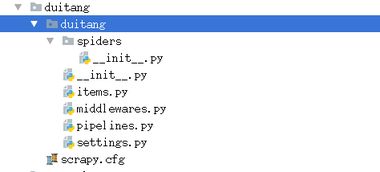

- 网络数据爬取: 针对互联网公开的网页、社交媒体、电商平台等信息,通过爬虫框架(如Scrapy、Nutch)进行结构化或非结构化数据的定向抓取。

- 数据库同步与采集: 对于传统关系型数据库(如MySQL、Oracle)和新兴NoSQL数据库(如MongoDB、HBase),通过CDC(变更数据捕获)、数据导出导入或专用连接器(如Sqoop、Canal)进行数据抽取。

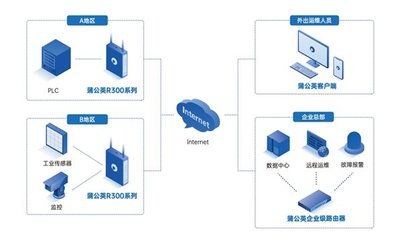

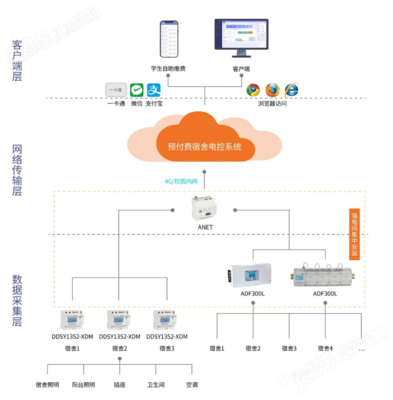

- 物联网与传感器数据采集: 面对海量、实时、流式的物联网终端数据,需要轻量级协议(如MQTT、CoAP)和边缘计算网关进行高效汇聚。

- 实时流数据采集技术:

- 为满足对实时性要求极高的场景(如金融风控、实时监控),Apache Kafka、Apache Pulsar等消息队列成为关键基础设施。它们作为高吞吐、低延迟的分布式发布-订阅系统,扮演着“数据总线”的角色,将源源不断的数据流可靠地传输给下游处理系统。

- 数据采集的质量与治理:

- 在采集阶段即需关注数据质量,包括完整性、准确性、一致性、时效性。通过数据清洗规则、元数据管理和数据血缘追踪(如Apache Atlas)的初步应用,为后续处理奠定良好基础。

二、 大数据处理:化繁为简,洞见价值

采集到的原始数据通常是杂乱、冗余、非结构化的“数据矿石”。大数据处理技术的使命,就是通过一系列计算、加工与组织,将其提炼为可供分析的“信息金块”。处理范式主要分为批处理和流处理。

关键技术包括:

- 批处理技术:

- 核心引擎:Apache Hadoop MapReduce。其“分而治之”的思想(Map分解任务,Reduce汇果)奠定了大规模离线数据处理的基础,适合处理海量历史数据,计算延迟通常在分钟到小时级。

- 更高效的演进:Apache Spark。通过引入内存计算和有向无环图(DAG)执行引擎,Spark在迭代计算、交互式查询等场景上比MapReduce快数十到百倍,同时提供了Spark SQL、MLlib等丰富的上层库,统一了批处理与部分流处理能力。

- 流处理技术:

- 早期框架:Apache Storm,提供了低延迟的流处理能力,但语义相对简单。

- 新一代引擎:Apache Flink 和 Spark Streaming(结构化流)。Flink以其真正的流处理架构(逐事件处理)、精确一次(exactly-once)的状态一致性保证和高吞吐低延迟的特性成为行业热点。Spark Streaming(及之后的Structured Streaming)则提供了基于微批的、与批处理高度API统一的数据流处理方案。

- 数据处理的核心支撑技术:

- 分布式存储: 如Hadoop HDFS、阿里云OSS等,提供高可靠、高扩展的海量数据存储底座。

- 资源管理与调度: 如Apache YARN、Kubernetes,负责在集群中高效、公平地分配计算资源(CPU、内存)给各个处理任务。

- 数据处理与仓库工具: 如Apache Hive(基于Hadoop的数据仓库工具,使用类SQL语言)、Apache HBase(分布式列式数据库,支持实时读写)。

三、 融合与趋势:采集与处理的边界淡化

当前,大数据技术的发展呈现出 “采存算一体” 和 “批流融合” 的明显趋势。

- 数据湖仓一体:将数据湖(存储原始格式数据,灵活性高)与数据仓库(存储清洗后的结构化数据,性能优)的能力融合,支持从原始数据到分析报表的全链路处理,简化架构。

- 一体化处理框架:如Apache Spark和Apache Flink,都在不断增强其统一处理能力,力求用一个框架、一套API解决批处理、流处理、机器学习和图计算等多种计算需求,降低开发与运维复杂度。

- 实时化与智能化:数据采集与处理的延迟要求越来越高,实时数仓、实时决策成为标配。AI与机器学习能力(特征工程、模型训练)正深度嵌入数据处理流程,实现从“处理数据”到“从数据中学习”的跃迁。

###

大数据采集与处理,如同数据价值炼金术的“采集原料”与“初步冶炼”阶段。采集技术决定了我们能够触及的数据世界的广度与实时性,而处理技术则决定了我们从庞杂数据中提取结构化信息和初步洞察的效率与深度。随着技术的不断融合演进,这两大环节正变得更加无缝、智能与高效,共同支撑起上层丰富多彩的数据分析与智能应用,持续释放着大数据的巨大潜能。

如若转载,请注明出处:http://www.antscloudsec.com/product/70.html

更新时间:2026-04-16 18:20:06